Fake newsy to tak naprawdę nic nowego. Fałszywe wiadomości pojawiały się odkąd istnieją media. Teraz jednak ich kolportowanie na niespotykaną dotąd skalę w internecie jest możliwe właśnie m.in. dzięki sztucznej inteligencji. Czy rozwiązania z pogranicza maszynowego uczenia się i sztucznej inteligencji powstrzymają rozprzestrzenianie się fake newsów?

„Szczepionki powodują autyzm, ziemia jest płaska, a sieć 5G to zagrożenie dla społeczeństwa”. Choć teorie spiskowe były są i będą, to nigdy w historii ludzkości nie mieliśmy do czynienia z taką skalą dezinformacji, jak teraz.

W procederze fabrykowania fałszywych informacji niestety coraz częściej bierze udział sztuczna inteligencja, a jej moce przerobowe są praktycznie nieograniczone. Pojawia się jednak światełko w tunelu i wygląda na to, że algorytmy będą ze sobą konkurować.

Kto z tej batalii wyjdzie zwycięsko?

Algorytmy piszą własne teksty

Generator tekstów GPT-2 pozwala na tworzenie fałszywych wiadomości na dowolny temat. OpenAI zwlekało z publikacją kodu źródłowego ze względów etycznych, ale w końcu postanowiono upublicznić projekt. Poniżej znajduje się przykładowy tekst, który został stworzony przez algorytm na temat „Earth is flat”:

Earth is certainly not spherical, but that’s a small point. As for the Earth spinning like a top, that is what astronomers of old believed, too, but it’s wrong in a few fundamental ways. (You can read more here.)

According to recent research by Jeff Cramer at the Air Force Research Lab in Montgomery, Ala., the tilt of our planet’s axis is actually right around the 25.6-degree mark, a half degree under NASA’s current definition.

So a few more days of looking up the sky and you can see the sky map error, and try to come up with an idea of what the real Earth looks like, not just a featureless cloudscape.

Powyższy tekst zawiera błędy, ale jeśli go pobieżnie „skanujemy”, to możemy nie rozpoznać, że został stworzony przez algorytm. Generator działa poprawnie w języku angielskim, ale udostępnienie kodu źródłowego spowoduje, że algorytm już teraz jest wykorzystywany do fabrykowania fałszywych wiadomości w różnych wersjach językowych.

Tekstowe fake newsy to jednak jedynie wierzchołek góry lodowej. O wiele bardziej zaawansowane są tak zwane „deepfake”, które dla przeciętnego użytkownika są praktycznie niemożliwe do wykrycia:

Z fake newsami borykają się przede wszystkim media społecznościowe – to właśnie te platformy napędzają popularność fałszywych wiadomości, które często masowo udostępniane przez użytkowników, nieświadomych tego, że dystrybuują fałszywe informacje. Trzeba tutaj jednak dodać, że media tradycyjne i uznane tytuły również mają problem z tak zwanym fact checkingiem, ale jest to znacznie szerszy problem, po części związany rynkowymi kryteriami i szybkiemu tworzeniu treści.

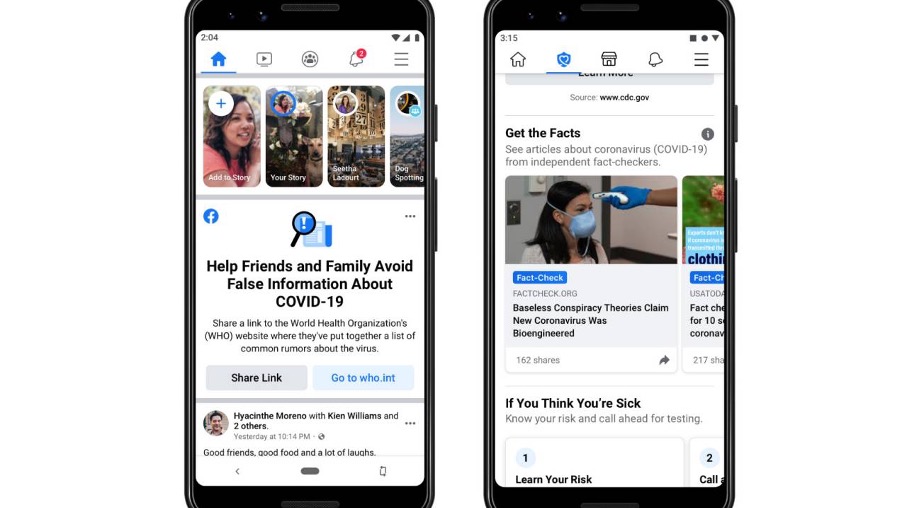

Zarówno Facebook, jak i Google zapowiadają już od jakiegoś czasu wprowadzenie mechanizmów wykrywających i „flagujących” fałszywe informacje. Obecnie niestety w głównej mierze robią to zatrudnieni weryfikatorzy treści, którzy ręcznie muszą sprawdzać zgłoszenia i fakty. Z czasem możemy się spodziewać, że algorytmy będą wyręczać „analogowych” pracowników.

Internet – skala nie do zweryfikowania?

Internet – skala nie do zweryfikowania?

Sztuczna inteligencja dopiero zaczyna „raczkować” w walce z dezinformacją, fake newsami czy niewiarygodnymi stronami internetowymi.

Warto także odnotować, że powstaje coraz więcej platform czy też organizacji pozarządowych, które monitorują autentyczność informacji w internecie. To jednak nadal jedynie kropla w morzu potrzeb, bo zasób fałszywych treści jest nieograniczony i wspierany przez algorytmy, które mogą codziennie „produkować” kolejne fałszywe informacje, mające zdyskredytować daną grupę społeczną, wywołać niepokój czy korzyści majątkowe dla ich twórców.

Wydaje się, że na ten moment o wiele doskonalsze są metody fabrykowania sztucznych treści tekstowych, video czy nawet dźwiękowych. Metody weryfikacji są nadal opracowywane, a co ważniejsze – nie zostały jeszcze wdrożone na szeroką skale przez największe koncerny medialne. Codziennie w sieci przybywa taka ilość treści, że nawet żaden algorytm nie jest w stanie ich na bieżąco „czytać” i weryfikować. Miejmy jednak nadzieję, że wkrótce uda się stworzyć narzędzia przyjazne dla zwykłych użytkowników, np. w postaci wtyczek do przeglądarek, które oznaczałyby niepewne źródła lub flagowały fałszywe informacje.

Sztuczna inteligencja w służbie dla branży tłumaczeniowej

Automatycznie generowanie treści na zadany temat oraz rozwój mechanizmów weryfikujących, to także szansa dla branży tłumaczeniowej. Już teraz powstają modele uwzględniające maszynowe uczenie się w przypadku tłumaczenia stron internetowych, tworzenia wielojęzycznych opisów produktów czy wsparcia obsługi Klienta poprzez chatboty.

Nietrudno sobie wyobrazić, że firmy tłumaczące będą mogły odgrywać istotną rolę w tworzeniu oprogramowania i algorytmów, które nie tylko skutecznie zweryfikują dokładność tłumaczenia, ale także sprawdzą prawdziwość treści.

Źródła:

https://fakenews.pl/blog/deepfake-i-fake-news-poradnik-dla-myslacych/

https://fakenews.pl/blog/generator-fake-news-od-openai-juz-dostepny/

https://www.facebook.com/facebookmedia/blog/working-to-stop-misinformation-and-false-news