Fake news är inte något nytt. Falska nyheter har funnits lika länge som vi har haft medier. Men skillnaden är att de idag kan distribueras i enorm omfattning via Internet, med hjälp av artificiell intelligens. Frågan är om lösningar inom maskininlärning och artificiell intelligens kan användas för att stoppa spridningen av falska nyheter?

”Jorden är platt.” ”Vaccin orsakar autism.” ”5G-nätverket är ett hot mot samhället.” Även om konspirationsteorier har existerat länge, och även om det inte finns något som tyder på att de kommer att försvinna i brådrappet, har vi aldrig tidigare sett desinformation spridas så snabbt, speciellt som vanliga nyheter.

Artificiell intelligens erbjuder i princip obegränsade databehandlingsmöjligheter och används därför alltmer för att fabricera falsk information. Men det finns ett ljus i slutet av tunneln: algoritmer mot falska nyheter skapas för att motverka spridningen av falsk information.

Vem kommer att gå segrande ut ur den här kampen?

Algoritmer skriver sin egen text

Med InferKit skulle du kunna skapa falska nyheter om vilket ämne som helst.

OpenAI försenade till en början källkoden av etiska skäl, men till slut offentliggjordes den.

Här nedan följer ett exempel på vad textgeneratorn kan producera på engelska. Det är en text som baseras på inputämnet ”the Earth is flat”.

Earth is certainly not spherical, but that’s a small point. As for the Earth spinning like a top, that is what astronomers of old believed, too, but it’s wrong in a few fundamental ways. (You can read more here.) According to recent research by Jeff Cramer at the Air Force Research Lab in Montgomery, Ala., the tilt of our planet’s axis is actually right around the 25.6-degree mark, a half degree under NASA’s current definition. So a few more days of looking up the sky and you can see the sky map error, and try to come up with an idea of what the real Earth looks like, not just a featureless cloudscape.

Texten ovan är inte perfekt, men om du läste igenom den lite hastigt märkte du kanske inte att den har genererats med hjälp av AI. Och även om generatorn just nu bara fungerar på engelska innebär den offentligt tillgängliga källkoden att algoritmen kan anpassas för att fabricera falska budskap på olika språk.

Falska nyheter i textform är dock bara toppen på isberget. Så kallade ”deep fakes” är mycket mer avancerade, och gemene man kommer sannolikt inte att upptäcka dem.

Just nu är falska nyheter det som sociala medier-plattformar har mest problem med. På dessa plattformar blomstrar de falska nyheterna när användare delar dem i massiv omfattning. Ofta är de inte medvetna om att de delar falsk information. Det är värt att nämna att även traditionella medier och erkända publikationer har problem med faktagranskning, men detta är ett mycket mer djupgående problem som delvis är relaterat till behovet av att skapa innehåll snabbt.

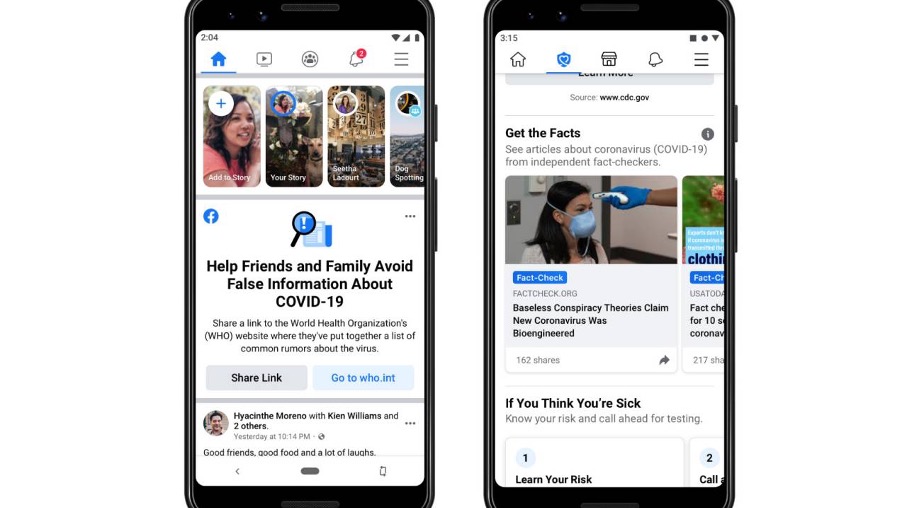

Både Facebook och Google har annonserat att de har planer på att introducera mekanismer som upptäcker och flaggar falsk information. Men idag upptäcks falska nyheter främst av mänsklig personal som verifierar innehåll och som måste kontrollera rapporter och fakta manuellt. Med tiden kan vi förvänta oss att algoritmer kommer att ta över det mesta av detta manuella arbete.

Är Internet för stort för att kunna verifieras?

Artificiell intelligens har precis börjat kampen mot desinformation, falska nyheter och opålitliga webbplatser.

Det är också värt att notera att allt fler plattformar och icke-statliga organisationer skapas för att granska om informationen på Internet är tillförlitlig. Men dessa motmedel är fortfarande bara en droppe i havet.

Det beror på att det finns obegränsade möjligheter att skapa falskt innehåll, och att detta stöds av algoritmer som dagligen kan ”producera” falsk information, i syfte att misskreditera en viss social grupp, orsaka ilska eller skapa ekonomiska eller politiska förmåner åt dem som skapar dem.

Det finns så mycket nytt innehåll på webben att ingen algoritm och ingen människa kan ”läsa” och verifiera allt regelbundet.

Verifieringsmetoderna för att upptäcka artificiell text, artificiella videor eller till och med artificiellt ljudinnehåll är fortfarande under utveckling. Hittills har arbetet med detta ännu inte implementerats av de stora medieföretagen i någon större omfattning.

Förhoppningen är att det snart kommer användarvänliga verktyg, som kan markera opålitliga källor eller flagga falsk information, till exempel i form av insticksprogram för webbläsare.

Kan översättningsbranschen spela en roll när det gäller att upptäcka falska nyheter?

Översättningsbranschen är redan djupt integrerad i maskininlärningens roll vad gäller att generera och upptäcka naturligt språk.

Maskininlärningen används till exempel redan för lokaliseringsprojekt som översättning av webbplatser. Den kan generera flerspråkiga produktbeskrivningar och användas för att ge kundtjänstsupport via dialogrobotar.

Därför är det inte alls omöjligt att tänka sig att översättningsbyråer skulle kunna spela en roll i utvecklingen av programvara och algoritmer som inte bara effektivt verifierar att en översättning är korrekt, utan även verifierar sanningshalten i de påståenden som finns i det aktuella innehållet.

Källor:

https://fakenews.pl/blog/deepfake-i-fake-news-poradnik-dla-myslacych/

https://fakenews.pl/blog/generator-fake-news-od-openai-juz-dostepny/

https://www.facebook.com/facebookmedia/blog/working-to-stop-misinformation-and-false-news